이 글에서 정리하는 내용

2026년 4월 16일 작성 기준으로 주요 생성형 모델을 클로즈드 모델과 오픈웨이트 모델로 나눠 정리하고, 공식 문서에 공개된 컨텍스트 길이가격, 벤치마크를 기준으로 분야별 순위와 선택 기준을 함께 정리합니다. 모델 출시와 가격은 빠르게 바뀌므로 실제 도입 전 최신 공식 문서를 다시 확인해야 합니다.

2026년 4월 28일 최신성 메모: OpenAI는 2026년 4월 23일 GPT-5.5를 공개했습니다. 따라서 이 글의 GPT-5.4 비교는 2026년 4월 16일 기준 스냅샷으로 읽고, 실제 도입 전에는 OpenAI 공식 모델 문서와 각 공급사의 최신 문서를 다시 확인해야 합니다.

왜 AI 모델 순위를 하나로 적지 않는가

이 비교 글을 쓸 때 가장 먼저 부딪히는 문제는 모델명이 아니라 비교 기준입니다. 어떤 모델은 stable 상태로 널리 배포되어 있고, 어떤 모델은 preview 단계이며, 어떤 모델은 이미 retirement 일정이 잡혀 있습니다. 그런데 이 상태 차이를 무시하고 모든 모델을 한 줄로 세워 순위를 매기면 글이 빠르게 낡습니다. 그래서 이 글에서는 2026년 4월 기준으로 공식 문서에서 확인되는 현행 AI 모델만 먼저 추리고, 종합 추론, 실무형 에이전트, 장문맥가성비처럼 축을 나눠 순위를 읽겠습니다.

비교 대상을 먼저 고정하는 기준

// 이 글에서 쓰는 선정 규칙입니다.

// retired, deprecated, shut down 표시는 제외하거나 별도 주석으로 다룹니다.

// stable 또는 current preview 상태의 현행 모델만 본문 비교표에 넣습니다.

const scope = { date: "2026-04", include: ["stable", "current-preview", "current-api-model"], exclude: ["retired-chat-model", "legacy", "image-only", "audio-only"], rankingAxes: ["reasoning", "agentic", "coding", "long_context", "value"]

};이 기준을 먼저 잡아두면 모델 이름이 자주 바뀌더라도 글의 중심이 흔들리지 않습니다. 특히 공식 벤치마크는 reasoning effort, tool 사용 여부, single attempt 여부처럼 측정 조건이 다를 수 있어 숫자만 옮기면 오해가 생깁니다. 따라서 여기서는 공급자가 직접 공개한 스펙과 벤치마크를 먼저 읽고, 서로 공통으로 겹치는 지표가 있는 곳만 순위를 비교하겠습니다. 공통 지표가 부족한 영역은 숫자 경쟁보다 용도 중심으로 해석하겠습니다.

2026년 4월 기준 주요 모델 지도

현재 시장은 크게 네 갈래로 읽는 편이 정리하기 쉽습니다. 첫째는 고성능 클로즈드 플래그십 AI 모델입니다. GPT-5.4, Claude Opus 4.6, Claude Sonnet 4.6, Gemini 3.1 Pro Preview, Grok 4.20이 여기에 들어갑니다. 둘째는 경량·가성비 모델입니다. GPT-5.4 mini와 nano, Claude Haiku 4.5, Gemini 2.5 Flash와 3.1 Flash-Lite Preview가 대표적입니다. 셋째는 오픈웨이트 범용 모델입니다. Mistral Large 3, Llama 4, Qwen3, DeepSeek-V3.2 계열이 이 축에 놓입니다. 넷째는 코딩 특화 모델입니다. Qwen3-Coder나 각 공급자의 상위 reasoning 모델이 여기에서 다시 경쟁합니다.

공식 스펙으로 먼저 보는 대표 모델

// 글의 중심에 둘 대표 모델만 먼저 뽑아봅니다.

// 본문에서는 이 목록을 기준으로 분야별 순위를 나눠 읽습니다.

const models = [ { name: "GPT-5.4", focus: "agentic + professional work", context: "1,050,000", output: "128k" }, { name: "Claude Opus 4.6", focus: "reasoning + coding", context: "1M", output: "128k" }, { name: "Gemini 3.1 Pro Preview", focus: "reasoning + multimodal", context: "1M", output: "64k" }, { name: "Grok 4.20", focus: "long context + tool calling", context: "2,000,000", output: "reasoning model" }

];대표 AI 모델만 놓고 봐도 성격 차이가 꽤 뚜렷합니다. GPT-5.4는 1.05M 컨텍스트와 128k 출력 토큰, 전문 업무와 도구 사용 능력을 앞세우는 모델입니다. Claude Opus 4.6은 1M 컨텍스트와 128k 출력을 바탕으로 지능, 코딩, 장기 작업 안정성을 강조합니다. Gemini 3.1 Pro Preview는 Preview 상태이지만 강한 추론과 멀티모달 작업을 전면에 내세웁니다. Grok 4.20은 2M 컨텍스트가 가장 먼저 눈에 들어오고, agentic tool calling 성격이 분명합니다. 여기서 중요한 점은 같은 모델 비교라도 어떤 숫자를 먼저 보느냐에 따라 해석이 달라진다는 점입니다.

| 모델 | 핵심 스펙 |

|---|---|

| GPT-5.4 | 1,050,000 컨텍스트, 128k 출력, 입력 1M 토큰당 $2.50 / 출력 1M 토큰당 $15.00, 전문 업무와 에이전트 워크플로 중심 |

| Claude Opus 4.6 | 1M 컨텍스트, 128k 출력, 입력 1M 토큰당 $5 / 출력 1M 토큰당 $25, 지능·코딩·장기 작업 중심 |

| 모델 | 핵심 스펙 |

|---|---|

| Gemini 3.1 Pro Preview | Preview, 1M 입력, 64k 출력, 복잡한 멀티스텝 작업과 추론 중심 |

| Grok 4.20 | 2,000,000 컨텍스트, reasoning·function calling·structured output 지원도구 활용형 작업에 강점 |

| 모델 | 핵심 스펙 |

|---|---|

| Mistral Small 4 | 256k 컨텍스트, 입력 1M 토큰당 $0.15 / 출력 1M 토큰당 $0.6, 저비용 hybrid 모델 |

| Qwen3-235B-A22B | 오픈웨이트 플래그십, 235B total / 22B activated, 128k 컨텍스트, Apache 2.0 공개 |

공식 스펙 기반 분야별 순위

// 단일 종합 점수 대신 카테고리별 우선순위로 읽습니다.

// 숫자가 겹치는 곳은 직접 순위를 매기고,

// 숫자가 안 겹치는 곳은 용도 중심으로 해석합니다.

const ranking = { reasoning: ["Gemini 3.1 Pro Preview", "Claude Opus 4.6", "Claude Sonnet 4.6"], agentic_work: ["GPT-5.4", "Gemini 3.1 Pro Preview", "Grok 4.20"], long_context: ["Grok 4.20", "GPT-5.4", "Claude 4.6 / Gemini 3.1 Pro"], value: ["Mistral Small 4", "GPT-5.4 nano", "Gemini 3.1 Flash-Lite Preview"]

};공통 비교표 기준으로 보면 종합 추론 상위권은 Gemini 3.1 Pro Preview, Claude Opus 4.6, Claude Sonnet 4.6 순으로 읽는 구성이 자연스럽습니다. 반면 실무형 에이전트와 컴퓨터 사용 능력은 GPT-5.4가 가장 앞에 놓입니다. OpenAI는 GDPval, SWE-Bench Pro, OSWorld-Verified, BrowseComp, Atlas 같은 지표를 함께 제시하면서 GPT-5.4를 전문 업무용 모델로 설명하고 있습니다. 장문맥은 단순히 품질을 뜻하는 숫자가 아니라 입력 수용량과 활용 가능 범위를 보여주는 수치에 더 가깝기 때문에이 구간에서는 2M 컨텍스트의 Grok 4.20이 먼저 눈에 띕니다. 가성비 축은 가격표를 보면 Mistral Small 4, GPT-5.4 nano, Gemini 3.1 Flash-Lite Preview가 강하게 보입니다.

순위를 읽을 때 같이 봐야 할 숫자

// 좋은 모델을 고를 때는 순위보다 조합을 봐야 합니다.

// 컨텍스트 길이, 출력 토큰가격도구, 상태를 같이 읽어야 합니다.

const checklist = [ "context_window", "max_output_tokens", "tool_use_and_reasoning", "price_per_1M_tokens", "stable_or_preview"

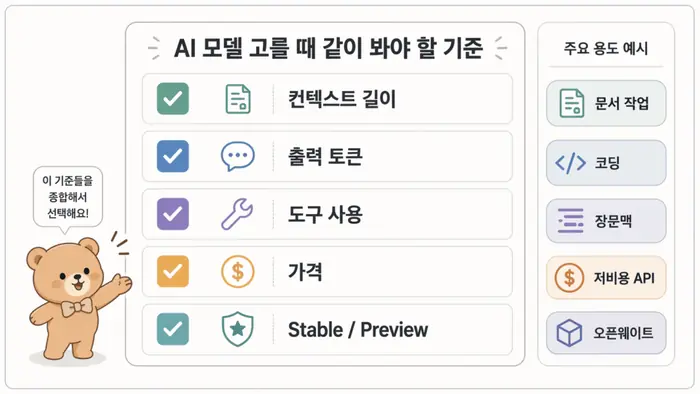

];AI 모델 순위를 읽을 때 가장 많이 생기는 오해는 한 숫자가 모든 것을 대표한다고 생각하는 점입니다. 예를 들어 컨텍스트 길이가 길다고 해서 실제 장문맥 품질이 자동으로 가장 좋은 것은 아닙니다. 반대로 벤치마크 점수가 높다고 해서 가격 효율까지 함께 좋은 것도 아닙니다. 그래서 이 글에서는 모델을 고를 때 컨텍스트 길이, 최대 출력 토큰도구 사용 방식가격, stable 또는 preview 상태를 한 묶음으로 보겠습니다. 이 다섯 가지를 같이 읽어야 실제 도입 판단이 쉬워집니다.

오픈웨이트 모델은 다시 분리해서 읽는 편이 좋습니다. 범용 오픈웨이트 상위권은 Mistral Large 3, Llama 4, Qwen3가 중심이고, 코딩 특화 오픈웨이트는 Qwen3-Coder가 먼저 거론됩니다. 이 구간은 단순 성능뿐 아니라 배포 가능성, 라이선스, 자체 추론 파이프라인 구성 가능성까지 같이 봐야 하므로, 클로즈드 AI 모델과 같은 기준표 하나로 정리하기보다는 별도 축으로 두는 편이 자연스럽습니다.

어떤 모델을 언제 선택할까

실무에서는 결국 AI 모델 이름보다 사용 시나리오가 더 중요합니다. 문서 분석, 발표 자료 작성, 스프레드시트 정리처럼 지식 노동 산출물이 중요하면 GPT-5.4가 먼저 떠오릅니다. 긴 코드베이스를 안정적으로 다루는 균형형 모델은 Claude Sonnet 4.6이 강한 후보입니다. 가장 어려운 추론 문제나 복잡한 멀티모달 추론은 Gemini 3.1 Pro Preview가 먼저 검토 대상이 됩니다. 장문맥과 검색 중심 에이전트 작업은 Grok 4.20이 눈에 띄고, 예산에 민감한 API 서비스는 Mistral Small 4나 GPT-5.4 nano가 현실적인 선택지입니다. 자체 배포를 고려한다면 Mistral Large 3, Qwen3, Llama 4 같은 오픈웨이트 계열을 함께 검토하는 흐름이 자연스럽습니다.

업무 시나리오별 선택

// 업무 성격에 따라 시작 모델을 다르게 잡습니다.

// 이후에는 실제 데이터셋으로 벤치마크를 다시 돌려 미세 조정합니다.

function chooseModel(task: string) { if (task === "knowledge-work") return "GPT-5.4"; if (task === "hard-reasoning") return "Gemini 3.1 Pro Preview"; if (task === "balanced-coding") return "Claude Sonnet 4.6"; if (task === "ultra-long-context") return "Grok 4.20"; if (task === "budget-api") return "Mistral Small 4 or GPT-5.4 nano"; return "Mistral Large 3 / Qwen3 / Llama 4";

}예산 제약이 강한 경우에는 DeepSeek 계열도 비교 목록에 넣는 편이 좋습니다. 다만 DeepSeek는 앱과 웹에서 보이는 이름, API에서 쓰는 alias, thinking 모드와 non-thinking 모드 설명이 분리되어 있어 초반에는 다소 헷갈릴 수 있습니다. 이런 AI 모델은 메인 순위표에 강제로 밀어 넣기보다 예산형 대안 섹션에서 따로 다루는 편이 더 읽기 쉽습니다. Google 쪽에서는 2.5 Flash가 1M 컨텍스트를 갖춘 hybrid reasoning 모델이고, 3.1 Flash-Lite Preview는 대량 요청에 맞춘 cost-efficient 모델로 정리할 수 있습니다.

결론

2026년 4월 기준으로 정리하면가장 어려운 추론은 Gemini 3.1 Pro Preview, 실무형 agentic work는 GPT-5.4, 균형형 코딩은 Claude Sonnet 4.6, 장문맥은 Grok 4.20, 저비용 API는 Mistral Small 4, 범용 오픈웨이트는 Mistral Large 3, 오픈 코딩 모델은 Qwen3-Coder가 가장 먼저 거론됩니다. 다만 이 순위는 어디까지나 공식 문서 기준의 현재 정리입니다. 실제 도입 단계에서는 내 데이터, 내 워크플로, 내 예산, 내 보안 조건으로 다시 검증해야 합니다. 결국 좋은 모델은 절대 1등 모델이 아니라, 내 작업에 가장 잘 맞는 모델입니다.

많이 받는 질문

Q. 왜 GPT-5.4를 종합 1위로 바로 적지 않았나요?

공급자 간 공통 비교표에 모든 모델이 같은 조건으로 들어가 있지 않기 때문입니다. 어떤 곳은 search+code를 켜고 측정하고, 어떤 곳은 reasoning effort 조건이 다르며, 어떤 곳은 preview 모델을 앞세웁니다. 그래서 이 글에서는 공통 지표가 겹치는 추론 순위와 실무형 에이전트 순위를 분리해서 읽도록 정리했습니다.

Q. Preview 모델도 순위에 넣어도 되나요?

넣을 수는 있지만 stable AI 모델과 같은 의미로 읽으면 안 됩니다. Preview 모델은 성능 참고용으로는 유효하지만, 프로덕션 기본값으로 바로 고정하기보다는 버전 고정과 회귀 테스트를 먼저 거치는 편이 안전합니다. 특히 모델 교체 주기가 빠를 때는 더 그렇습니다.

Q. 1M이나 2M 컨텍스트 숫자가 크면 실제 장문맥 성능도 자동으로 좋은가요?

그렇게 보면 안 됩니다. 컨텍스트 윈도는 입력 수용량에 가깝고, 실제 장문맥 품질은 회수 정확도, 검색 전략, 압축 방식, 장기 추론 안정성까지 함께 봐야 합니다. 따라서 장문맥 모델을 비교할 때는 숫자 하나보다 실제 문서 검색과 회수 테스트를 같이 확인하는 편이 정확합니다.

참고 링크

아래 링크는 이 글에서 언급한 AI 모델의 공식 문서와 발표 자료입니다. 비교 기준과 수치는 시점에 따라 바뀔 수 있으므로, 실제 확인 시에는 각 공식 페이지의 최신 내용을 함께 보는 편이 안전합니다.

“AI 모델 비교 2026: GPT Claude Gemini Grok 스펙 기준”에 대한 3개의 생각