이 글에서 정리하는 내용

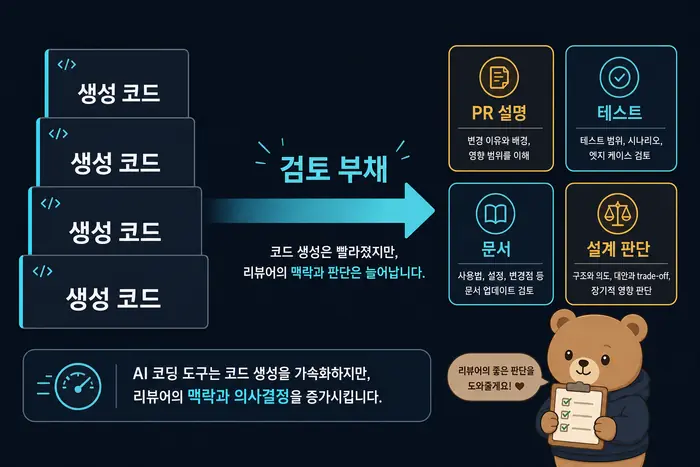

AI 코딩 도구는 코드를 빠르게 만들어주지만, 팀이 검토해야 할 코드·맥락·의사결정까지 함께 늘립니다. 이 글은 AI 사용 후 생기는 검토 부채를 PR 리뷰, 테스트, 문서화, 아키텍처 승인 관점에서 정리하고, 팀에서 바로 적용할 수 있는 규칙을 제안합니다.

- 코드는 빨리 늘었는데 리뷰는 더 무거워지는 순간

- 생성 속도와 개발 완료 속도는 다르다

- PR 리뷰에서 생기는 검토 부채

- 테스트, 문서, 아키텍처에서 놓치기 쉬운 비용

- 검토 부채를 줄이는 팀 규칙

코드는 빨리 늘었는데 리뷰는 더 무거워지는 순간

AI 코딩 도구를 쓰면 기능 초안은 빠르게 나옵니다. 화면 하나, API 연결, 테스트 파일, 리팩터링 후보까지 몇 분 안에 만들어질 수 있습니다. 문제는 그다음입니다. PR은 커졌는데 작성자가 모든 변경 의도를 설명하지 못하고, 리뷰어는 diff뿐 아니라 AI가 숨어서 만든 가정까지 확인해야 합니다.

이때 생기는 비용을 검토 부채라고 볼 수 있습니다. AI가 생성한 결과물을 사람이 나중에 이해하고, 검증하고, 수정해야 하는 미뤄진 비용입니다. 코드 작성 속도는 올라갔지만 요구사항 이해, 설계 판단, 장애 대응 책임이 사라진 것은 아닙니다. 오히려 코드가 빨리 늘어난 만큼 검토해야 할 맥락도 같이 늘어납니다.

AI 코딩 자체를 피하자는 이야기는 아닙니다. AI 바이브 코딩 기준처럼 생산성을 얻으려면 코드 품질이 무너지기 전 확인할 기준이 필요합니다. 검토 부채는 AI 사용을 막는 개념이 아니라, 팀이 감당 가능한 방식으로 AI를 쓰기 위한 운영 기준에 가깝습니다.

생성 속도와 개발 완료 속도는 다르다

AI 도구가 만든 코드가 바로 개발 완료를 의미하지는 않습니다. 개발 완료에는 요구사항에 맞는지, 기존 구조와 충돌하지 않는지, 실패 상황을 처리하는지, 다음 사람이 수정할 수 있는지까지 포함됩니다. 생성 속도만 보면 생산성이 오른 것처럼 보이지만, 검토와 유지보수 단계에서 비용이 뒤늦게 나타날 수 있습니다.

예를 들어 AI가 폼 검증 로직을 만들었다고 해도 실제 서비스에서는 빈 값, 잘못된 형식, 중복 요청, 네트워크 실패, 접근성 메시지까지 봐야 합니다. happy path는 그럴듯해도 경계값과 운영 상황이 빠져 있으면 리뷰어가 다시 테스트 설계를 해야 합니다. 이 과정이 반복되면 리뷰어의 시간이 병목이 됩니다.

AI 생성 코드가 늘어남

→ PR diff 증가

→ 작성 의도 설명 부족

→ 리뷰어가 숨은 가정 검토

→ 테스트와 문서 보강 요구

→ 병합 속도 저하팀 입장에서는 “AI가 코드를 얼마나 빨리 만들었는가”보다 “그 코드를 얼마나 빨리 신뢰할 수 있는가”가 더 중요합니다. 신뢰 가능한 코드가 되려면 사람의 검토 기준이 함께 있어야 합니다.

PR 리뷰에서 생기는 검토 부채

AI가 만든 PR에서 가장 먼저 보이는 문제는 크기입니다. 작은 수정 하나를 요청했는데 관련 없는 리팩터링, 스타일 변경, 테스트 파일, 타입 수정이 함께 들어올 수 있습니다. 리뷰어는 실제 요구사항과 필요한 변경만 분리해서 봐야 하고, 이 과정에서 시간이 많이 듭니다.

두 번째 문제는 의사결정 설명입니다. 사람이 직접 작성한 코드도 설명이 부족할 수 있지만, AI가 만든 코드는 작성자가 “왜 이 구조를 선택했는지”를 충분히 이해하지 못한 채 제출될 가능성이 더 큽니다. 그러면 리뷰어는 코드의 현재 모습뿐 아니라 대안과 부작용까지 대신 검토하게 됩니다.

이 문제를 줄이려면 PR 설명에 AI 사용 범위를 적는 것이 좋습니다. “AI가 초안 작성”, “사람이 검증한 부분”, “아직 의심되는 부분”을 구분하면 리뷰어가 어디를 깊게 봐야 하는지 알 수 있습니다. VS Code Copilot 디버깅처럼 도구 로그를 확인하는 습관도 도움이 되지만, 최종 PR에는 사람이 이해한 설명이 남아야 합니다.

테스트, 문서, 아키텍처에서 놓치기 쉬운 비용

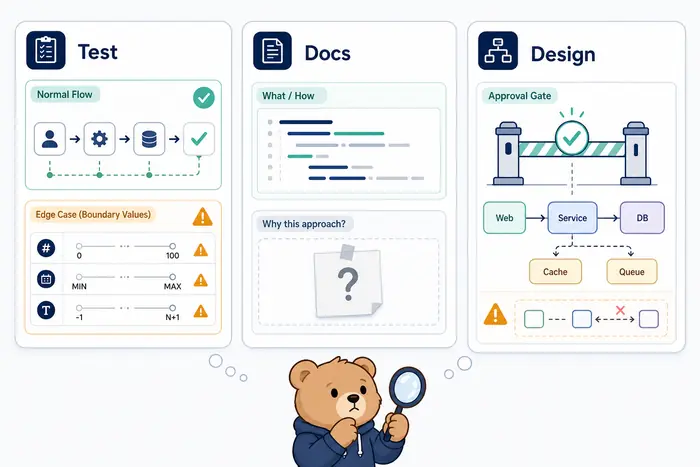

AI는 테스트 파일도 잘 만들어줍니다. 하지만 테스트가 있다는 사실과 위험을 제대로 덮었다는 사실은 다릅니다. 생성된 테스트가 정상 입력만 확인한다면 실제 장애 가능성은 여전히 남습니다. 경계값, 실패 응답, 권한 문제, 기존 데이터와의 충돌처럼 사람이 서비스 맥락을 알아야 잡을 수 있는 영역이 있습니다.

문서화도 비슷합니다. AI가 주석이나 README를 만들어도 “왜 이 방식을 선택했는가”가 빠지기 쉽습니다. 다음 개발자는 코드가 어떻게 동작하는지는 볼 수 있지만, 왜 다른 선택지를 버렸는지 알기 어렵습니다. 특히 보안, 인증, 결제, 배포처럼 영향이 큰 영역은 결정 배경이 없으면 수정 비용이 커집니다.

아키텍처 변경은 더 조심해야 합니다. AI가 제안한 구조가 지금 코드에는 맞아 보이더라도 팀의 배포 방식, 장애 대응 방식, 데이터 소유권과 충돌할 수 있습니다. AI 도구 사용법 자체는 AI 하네스 파일 사용법처럼 지침 파일로 정리할 수 있지만, 아키텍처 승인 책임은 사람에게 남아야 합니다.

검토 부채를 줄이는 팀 규칙

첫 번째 규칙은 AI가 만든 PR을 작게 쪼개는 것입니다. 한 PR에는 하나의 목적만 담고, 관련 없는 리팩터링은 분리합니다. 생성 속도가 빠르다고 큰 PR을 한 번에 올리면 리뷰 속도는 오히려 느려집니다.

두 번째 규칙은 테스트 기준을 코드 줄 수가 아니라 실패 시나리오 기준으로 요구하는 것입니다. “테스트가 있다”가 아니라 “어떤 위험을 막는 테스트인가”를 확인해야 합니다. 정상 흐름, 실패 흐름, 회귀 위험을 나누면 AI가 만든 테스트를 그대로 믿는 일을 줄일 수 있습니다.

세 번째 규칙은 설계 메모입니다. 복잡한 변경에는 짧게라도 선택 배경을 남깁니다. 어떤 대안을 고려했고, 왜 지금 방식을 선택했는지 적으면 다음 리뷰와 유지보수 비용이 줄어듭니다. 마지막으로 보안이나 아키텍처 관련 변경은 AI 초안이라도 사람의 명시적 승인 없이는 병합하지 않는 기준을 둬야 합니다.

또 하나의 규칙은 AI가 만든 부분을 숨기지 않는 것입니다. “AI가 작성했으니 믿을 수 없다”가 아니라, 어떤 범위를 도구가 초안으로 만들었고 사람이 어디까지 검증했는지 표시해야 합니다. 그래야 리뷰어는 전체를 처음부터 의심하지 않고, 위험한 부분에 시간을 집중할 수 있습니다.

팀 규모가 작아도 이 기준은 필요합니다. 혼자 개발하는 프로젝트에서도 며칠 뒤 코드를 다시 보면 작성 당시의 판단이 흐려집니다. AI가 만든 변경이라면 더더욱 왜 이 구조가 들어왔는지 기록해야 합니다. 작은 메모 하나가 다음 수정 때의 검토 부채를 줄입니다.

검토 부채를 줄이는 기준은 도구 선택보다 작업 방식에 가깝습니다. 어떤 모델을 쓰든 큰 PR, 빈약한 테스트, 설명 없는 구조 변경이 반복되면 팀의 신뢰 비용은 커집니다. 그래서 AI 도구 도입은 코드 생성 규칙과 리뷰 규칙을 함께 정할 때 효과가 안정적으로 남습니다.

AI 코딩의 진짜 생산성은 더 빨리 만드는 데서 끝나지 않습니다. 팀이 감당 가능한 검토 구조를 함께 만들 때 생산성이 실제로 남습니다. 코드 생성 속도와 코드 신뢰 속도를 분리해서 보면, AI 도구를 더 안전하고 오래 쓸 수 있습니다.